随着文本生成图像模型和3D视觉的快速发展,3D生成已成为一个重要且具挑战性的任务。由于3D数据稀缺,直接训练3D生成模型往往效果不佳。当前主流方法是利用图像生成模型辅助3D生成。然而,在3D纹理生成中,现有基于图像模型的方法难以兼顾高质量与多视角一致性。

对于以上问题,来自加拿大华为诺亚方舟实验室的高级研究员霍栋联合阿尔伯塔大学和多伦多大学的研究人员共同提出了基于多视图采样和重采样的文本引导三维纹理生成方法TexGen。TexGen通过对图像生成模型的多视角预测结果进行重采样,有效地解决了以上问题,并支持在保留细节的前提下进行纹理编辑和风格转换。相关论文为《TexGen: Text-Guided 3D Texture Generationwith Multi-view Sampling and Resampling》,已收录于ECCV 2024。

TexGen是一种新的技术路线,旨在通过文本引导的方式,来生成与任意文本描述相匹配的高质量3D纹理。

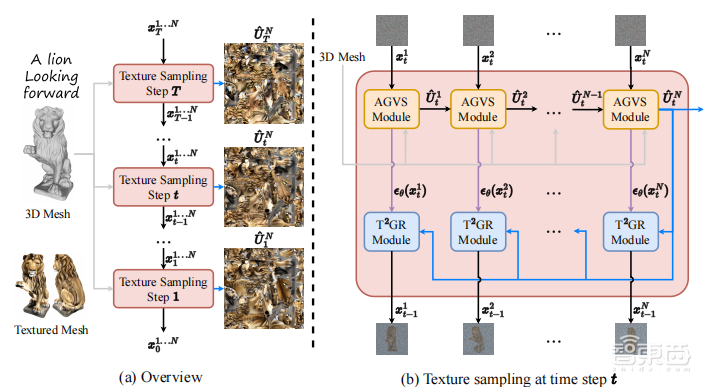

为了生成视角一致的纹理,TexGen首先采用多视角采样的方法。通过从多个视角对3D对象进行采样,以此获取到丰富的纹理信息。更进一步,为了确保生成的纹理在各个视角下都具备一致性,TexGen引入了一种注意力引导的多视角采样策略。这种策略能够使得不同视角下的纹理能够相互协调。

TexGen利用一个预训练的文本到图像的扩散模型来指导纹理的生成。这个模型能够根据用户输入的文本描述,生成与之相对应的图像,从而为纹理生成提供依据。

在去噪步骤中,TexGen会预测3D对象顺序采样视角的潜在去噪预测结果,并将这些去噪预测结果解码并更新到纹理图上,以有效降低视角间的差异,提高纹理的连贯性和自然度。TexGen还提出了一种噪声重采样技术来保护纹理细节。这种技术能够估算噪声,并为去噪步骤生成合适的输入,从而确保生成的纹理具有丰富的细节和逼真的外观。

利用这些关键技术,TexGen能够生成具有高度视角一致性和丰富外观细节的高质量纹理。此外,TexGen还可以应用于纹理编辑,同时保留原始身份。

9月24日10点,论文一作、加拿大华为诺亚方舟实验室高级研究员霍栋博士将参与「智猩猩通用视觉前沿讲座」并带来第1讲,主题为《基于文本引导的高质量3D纹理生成》。

取得哈尔滨工业大学软件工程学士学位,加拿大阿尔伯塔大学计算机科学博士学位。曾以一作发表顶刊TPAMI一篇,顶刊TIP两篇,顶会ECCV一篇。研究方向主要集中在计算成像,图像修复,图像理解,3D生成以及3D重建。

本次讲座组建了学习交流群。加入学习交流群,不仅可以提前获得直播地址与课件PPT,还能结识更多研究人员和开发人员,所提问题也会被讲者优先解答。

在线客服

电话咨询

官方微信

返回顶部